Умер Гордон Мур — сооснователь Intel и автор закона Мура

Если бы не Мур, возможно, не было бы ни персональных компьютеров, ни нынешней полупроводниковой индустрии

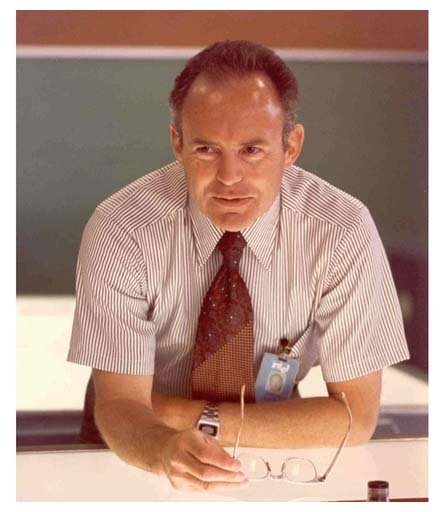

Сооснователь компании Intel, инженер и пионер полупроводниковой промышленности Гордон Мур (Gordon Moore) умер в пятницу в возрасте 94 лет. Именно он сформулировал закон Мура — эмпирическое наблюдение, согласно которому количество транзисторов, размещаемых на кристалле интегральной схемы, удваивается каждые два года.

Гордон Мур

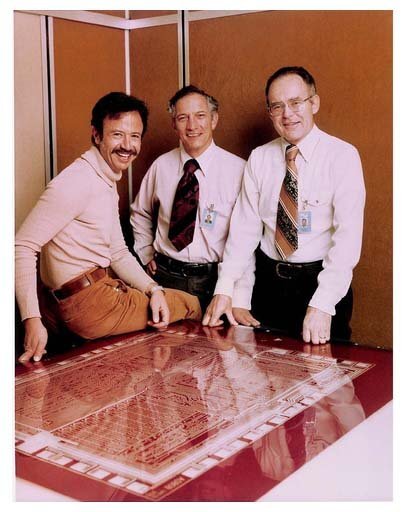

Мур и его коллега Роберт Нойс основали Intel в июле 1968 года. Первоначально Мур (до 1975 года) занимал должность исполнительного вице-президента, а потом стал президентом. В 1979 году Мур был назначен председателем совета директоров и главным исполнительным директором — эти должности он занимал до 1987 года. В 1997 году Гордон Мур стал почетным председателем совета директоров Intel, а в 2006 году ушел в отставку. До создания Intel Мур и Нойс основали Fairchild Semiconductor — компанию, которая сыграла одну из ключевых ролей в развитии полупроводниковой индустрии. Так, именно Fairchild Semiconductor создала первые в мире коммерческие интегральные схемы.

Слева направо: Энди Гроув, Гордон Мур и Роберт Нойс, руководители Intel на заре ее основания

В течение своей жизни Мур много уделял внимания проектам в сфере науки и охраны окружающей среды. Вместе со своей женой он основал «Фонд Гордона и Бетти Мур», который пожертвовал более 5,1 миллиарда долларов на благотворительные цели с момента своего основания в 2000 году.

«Гордон Мур определил технологическую индустрию благодаря своей проницательности и видению. Он сыграл важную роль в раскрытии мощи транзисторов и вдохновлял технологов и предпринимателей на протяжении десятилетий. Мы в Intel по-прежнему вдохновлены законом Мура и намерены следовать ему до тех пор, пока периодическая таблица не будет исчерпана», — сказал Пэт Гелсингер (Pat Gelsinger), генеральный директор Intel.

Это не статья-пиар!Я всего лишь донес информацию.

Тёмный кремний, закон Мура и "конечный компьютер" С. Лема

Краха закона Мура ждут чуть ли не столь же фанатично, как краха доллара, и столь же рьяно его отстаивают "технофанаты", дескать, до сих пор жив курилка, вон на 3 нм вышли и останавливаться не собираются! Но и здесь большинство, как с одной, так и с другой стороны, не вполне понимают, как должен выглядеть этот крах. Крах доллара не в том, что он станет продаваться по курсу 1 рубль/$ или 10 копеек/$, а в том, что всем вообще станет плевать на его курс. Подобным образом и крах закона Мура не в том, что не удастся более плотно "утрамбовывать" транзисторы на кристалл, а в том, что выгоды от дополнительных транзисторов становится всё меньше и меньше...

И если посмотреть под этим ракурсом, становятся понятны капризы компьютерной "моды".

Закон масштабирования Деннарда

Закон Мура гласил, что каждые 2 года количество транзисторов, упихиваемых в чип, будет удваиваться. Сначала темп был чуть выше, потом замедлился, сейчас замедлился ещё сильнее, но худо-бедно пока действует. Закон Деннарда известен куда меньше, вот одна из его формулировок: при переходе на следующий техпроцесс (в 1,5 раза меньше "нанометров"), на ту же площадь получится разместить вдвое больше транзисторов, при этом мы можем поднять тактовую частоту на 40% и остаться при том же тепловыделении на единицу площади! Именно это мы наблюдали поначалу: росли тактовые частоты, но также росли возможности процессоров - с 8- и 16-битных переходили на 32-битные и потом на 64-битные, появлялись всё новые и новые команды: плавающая запятая, всевозможные MMX, 3DNow, SSE, AVX и пр. Компьютер, которому исполнилось хотя бы несколько лет, уже казался безнадёжно устаревшим, поскольку новый был по всем параметрам лучше.

Ещё одним признаком, что закон масштабирования Деннарда был "в деле" - уменьшалось напряжение питания ядра. Когда-то КМОП-логика (она же CMOS) работала от 9 или даже 15 вольт (старые добрые серии 176 и 561), потом напряжение опустили до "ТТЛ-ного" 5 вольт, а затем и 3,3, 2,5, 1,8, вплоть до 1,2. Собственно, энергия, теряемая при переключении одного элемента, равна CU2/2, ёмкость C уменьшали с помощью новых техпроцессов, и они же позволяли снизить питающее напряжение, за счёт всё более и более тонкого диэлектрика при затворе. Именно эта закономерность и позволяла закону Деннарда выполняться.

Но увы, именно здесь быстрее всего упёрлись в предел: если истончить диэлектрик ещё сильнее, уже начинается квантовое туннелирование, затворы начинают невообразимо много потреблять, поэтому пришлось выбрать некоторое компромиссное значение - и на нём остановиться. Дальше напряжения уже практически не падали, из-за чего закон Деннарда приказал долго жить.

Конечный компьютер

Станислав Лем в романе "Фиаско" описал "компьютер поколения, называемого конечным, так как оно достигло теоретического предела мощности":

Границы ее определялись свойствами материи, такими, как постоянная Планка и скорость света. <…> Дилемма конструкторов проистекала из обязательных, но взаимопротиворечивых условий: как можно большее число нейронов заключить в как можно меньший объем. Время прохождения сигналов не должно превышать времени реакции элементов компьютера. В противном случае время прохождения ограничивает скорость расчетов. Новейшие датчики реагировали за одну стомиллиардную долю секунды. Они были размером с атом. Поэтому диаметр компьютера не превышал трех сантиметров. Будь он больше — работал бы медленней.

И по крайней мере, для технологии КМОП, по которой сейчас делается почти вся цифровая электроника, такой предел для одного ядра наступил.

Вот у нас был отличный процессор по старому техпроцессу. Появился новый техпроцесс, и мы можем его же упихать на половину кристалла. Пока действовал закон Деннарда, мы могли сохранить тактовую частоту прежней, понизить напряжение, и мощность на единицу площади даже упадёт, т.е отводить тепло становится только проще. Можно ещё и частоту поднять... Но закон приказал долго жить. Теперь можно лишь ожидать: если по новому техпроцессу изготовить старый процессор, то общая потребляемая мощность немного снизится. Мощность на единицу площади скорее возрастёт, и чтобы микросхема не сгорела, придётся тактовую частоту даже снизить! Можно, конечно, не ужиматься в половину кристалла, а разместить более мелкие транзисторы "как прежде", оставив большие расстояния между ними. Тогда тактовую частоту можно будет поднять, и процессор в какой-то степени ускорится, но на удивление немного! Ведь и дорожки между транзисторами нужно непрерывно укорачивать. Если мы самые классные маленькие транзисторы расставим подальше, ёмкость дорожек съест весь выигрыш!

Поэтому пошли по пути многоядерности: пусть вместо одного мощного и очень прожорливого ядра будет несколько более слабых, при этом общая вычислительная мощь увеличится. Пока работал закон Деннарда, многоядерность была не шибко привлекательна: одно ядро, работающее на максимальной частоте, потребляло бы столько же, сколько и два, работающих на половинной, зато его всегда можно было использовать на 100%, и программировать легко. Многоядерность была нужна не потому, что "её жаждали широкие народные массы", а потому что по-другому повышать быстродействие уже не могли, предельное быстродействие одного ядра практически наступило.

Но и увеличивать количество ядер без конца не имеет смысла, как следует из закона Амдала. Он, грубо говоря, утверждает: если в нашей программе есть 10% кода, который распараллелить не получится, то ставить сильно больше 10 ядер нет никакого смысла, скорость работы будет определяться этим "бутылочным горлышком". А таких горлышек довольно-таки много в реальном коде. Взять хотя бы ввод-вывод - здесь потоки будут "наступать друг другу на пятки". Или чисто последовательные процессы, вроде распаковки сжатого файла, где значение следующего бита становится понятно только после декодирования предыдущих.

Вот и наступила "эпоха тёмного кремния".

Новые техпроцессы позволяют запихать на кристалл миллиарды транзисторов, и они достаточно быстродействующие, чтобы работать на единицах, если не десятках гигагерц, но если мы попытаемся задействовать их все на такой частоте, кристалл мгновенно сгорит, и никакое, даже самое навороченное охлаждение ему не поможет! Поэтому львиная доля этих транзисторов должна оказаться "тёмной", т.е переключаться гораздо реже, чем они могли бы.

В общем-то, уже переход на многоядерность был "первым звоночком". Вместе с ним и тактовые частоты, которые "замерли" на 3 ГГц и поползли назад.

Ясно, что эти "лишние" транзисторы постарались пустить в ход, хотя бы как кэш-память. Память хороша в этом плане, она "тёмная": имеем миллионы транзисторов (мегабайты памяти), но в каждый момент времени записываем или читаем буквально несколько слов, остальные "сидят без дела". Но и здесь есть свои лимиты: с какого-то момента добавление кэш-памяти не сильно улучшает быстродействие.

Тема про тёмный кремний была довольно популярна в 2012..2014 году, писали научные и научно-популярные статьи, "4 всадников" перевели чуть ли не на каждый язык. Предлагалось чуть ли не "с нуля" начать проектирование программно-аппаратных систем, исходя из новой постановки задачи, создавать специализированные ядра, каждое под свою задачу, поскольку универсальные процессоры "родились", когда транзисторы приходилось экономить, а теперь транзисторы "бесплатны", денег стоит потребляемая ими мощность (поскольку вместе с ней растёт и размер кристалла), поэтому десяток узкоспециализированных ядер оказывается лучше одного универсального.

Но потом тема как-то взяла и затихла. Поискать dark silicon в том же ютубе - все лекции и материалы будут 10-летней давности. Именно среди научных статей можно найти и более новые, но по пальцем одной руки сосчитать. Похоже, нашёлся более простой путь развития...

Машинное обучение, нейросети, рейтрейсинг

Если произвольную задачу не удаётся распараллелить до конца, а существенно убыстрить одиночное ядро уже не удаётся, то что же делать? Элементарно: придумать такие задачи, которые на обычных процессорах решаются очень печально, но в которых допустимо массивное распараллеливание! И кто бы мог подумать, такие задачи резко нашлись и начали проталкиваться очень агрессивно. С одного конца, это нейросети. В них множество "параллельных ветвей", которые могут вычисляться независимо друг от друга, на разных ядрах, а вычислений нужна тьма тьмущая, особенно во время "обучения" этих сетей.

Со стороны видеокарт придумали рейтрейсинг. Раньше его применяли только для самых качественных рендеров, выполняемых далеко от реального времени. Но в данную канву он ложится идеально: каждый луч можно рассчитывать независимо от остальных, и рассчитать их нужно МНОГО, чтобы из этого получилось что-то красивое. Как будто снова решение подогнали под ответ.

Тайваньские нанометры

Надо сказать, что и транзисторы уменьшаться, по большому счёту, перестали, нельзя им уменьшаться, начинаются нехорошие квантовые эффекты, утечки и неуправляемость. А когда говорят к переходу к новому техпроцессу, заметно лукавят. По сути, совершенствуется методика "упаковки" транзисторов в стеснённых объёмах. Раньше они "лежали плашмя", потом их поставили на попа (бедный Шлаг, подумал Штирлиц), изгаляются, как могут. По сути, новая цифра техпроцесса означает: "мы смогли вместить на ту же площадь вдвое больше транзисторов", вот и всё. Цифра, как говорится, "маркетинговая".

Итоги

В общем-то, оно и невооружённым глазом заметно: сижу за компьютером 14-летней давности, и он нормально работает, жгучего желания бежать в магазин за новым не испытываю. Когда-то и за год-другой компьютеры успевали "морально устареть". Прогресс пока что продолжается, но "процессорам общего назначения" ловить практически нечего. Все преимущества новых техпроцессов проявляются только при выпуске сильно распараллеленных вычислителей, и, вот же совпадение, именно такие вычисления сейчас "на слуху".

Экстенсивное развитие цифровой техники (больше гигагерц, гигабайт, ядер), пожалуй, завершилось, теперь гораздо больше результатов даёт "вылизывание" имеющегося - более удачные архитектуры, а главное, более заточенные под конкретную задачу. Ну и пора отвыкать от 6-7 уровней абстракции между кодом и "железом", это теперь будет куда выгоднее, чем затариваться самым свежим "железом" - совсем недавно всё было наоборот.

https://aftershock.news/?q=node%2F1107058

Говорят, если гуманитарий пройдет это головоломку до конца, он может считать себя технарем

А еще получит ачивку в профиль. Рискнете?

Почти ежедневная иконка — закон Мура

Для тех, кто не в теме:

Изобретатель шахмат Гордон Эрл ПочешиМеняЗаУшком Мур продал свою настолку правителю Индии за одну электронную лампу на первой клетке шахматной доски, две лампы на второй, четыре — на третьей и т.д. с удвоением.

Мудрый правитель понял, что столько ламп на шахматной доске не уместится и изобрел транзисторы.

С тех пор Каспаров стал оппозиционером.

Для тех, кто реально не в теме:

Мур предсказал удвоение количества транзисторов в компах каждые два года (закон работает уже 64 года). А изобретатель шахмат просил удваивать рисинки на каждом следующем поле и это примерно 2000 ежегодных всепланетных урожаев.

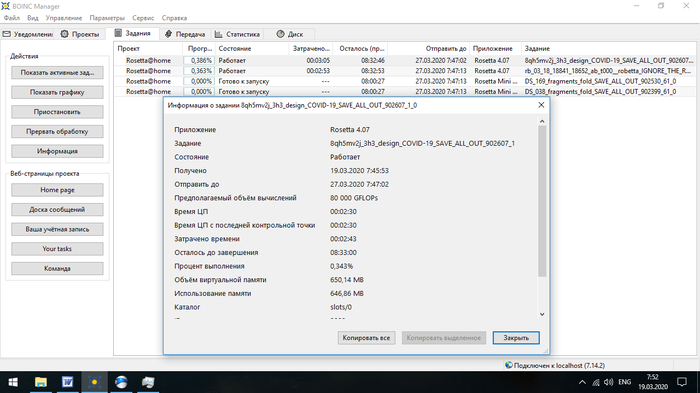

Наука@Home: распределенные вычисления на ПК

Наука@Home: распределенные вычисления на ПК

18.06.2014 Андрей Белокриницкий Андрей

В недалеком прошлом под научные расчеты создавались специальные вычислительные кластеры, однако их мощность не безгранична и ее постоянно не хватает для обработки всех данных. Следовательно, ученым пришлось искать доступ к новым вычислительным ресурсам. Вместо покупки очередных дорогих компьютеров пошли альтернативным путем и начали использовать ПК обычных пользователей, которые те безвозмездно отдавали для расчетов во имя науки.

Сначала эта затея выглядела малоперспективной, ведь в середине девяностых, когда лишь начали появляться первые сети распределенных вычислений в их текущем виде, частота процессоров едва преодолела порог в 100 Мгц, Интернет был редкостью, а о доступе к действительно большому числу компьютеров не шло и речи.

Тем не менее, развитие Всемирной Сети и увеличение производительности процессоров в полном соответствии с законом Мура привело к тому, что сейчас распределенные сети на равных конкурируют с топовыми суперкомпьютерами, причем, в отличие от них, постоянно совершенствуются и не стоят ни копейки.

Если взглянуть на изменения в распределенных сетях за последние несколько лет, то можно сразу отметить несколько ключевых моментов.

Наверное, самым важным и пока еще не до конца раскрывшим себя шагом стал переход на GPU-вычисления, в некоторых случаях ускоряющий расчеты на порядок. Значительную роль сыграла и оптимизация вычислительных алгоритмов под многоядерные процессоры, возможность одновременного выполнения расчетов на CPU и GPU, поддержка 64-битных вычислений, появление клиентов для игровых консолей, поддержка альтернативных операционных систем (Mac OS X, Linux), быстрое распространение Интернета, и что немаловажно, заметное упрощение клиентов, которые больше не требуют от пользователей запуска вычислений через командную строку.

Сравнение с суперкомпьютерами

Сети распределенных вычислений уже называют виртуальными суперкомпьютерами, и приставка «виртуальные» здесь скорее используется для дифференциации от классических суперкомпьютеров, поскольку по скорости работы оба типа вычислительных систем находятся практически на одном уровне.

По состоянию на октябрь 2012 года проект Folding@home «завербовал» 219 тыс. процессоров, 20 тыс. GPU, 16 тыс. консолей PlayStation 3, и его суммарная мощность составила 3.7 petaFLOPS (пиковая мощность 6 petaFLOPS была зарегистрирована в ноябре 2011 г.). По данным за этот же месяц, производительность BOINC (всех проектов, входящих в состав этой сети) составляет 6.6 petaFLOPS (на момент публикации материала — 7.4 petaFLOPS, по данным официального сайта, но эта цифра подсчитывается лишь за последние 24 часа).

Если эти виртуальные вычислительные системы разместить в списке суперкомпьютеров, то они втиснутся между третьей и четвертой строчкой рейтинга, заметно опережая ближайшего конкурента (производительность SuperMUC, занимающего сейчас четвертое место, составляет 3.1 petaFLOPS).

Для того, чтобы подняться на первое место, Boinc необходимо быть быстрее приблизительно в три раза, поскольку рейтинг Sequoia (самого производительного на текущий момент суперкомпьютера в мире) составляет 20.1 petaFLOPS. Учитывая, что этот компьютер в полную мощность заработал лишь летом этого года, можно предположить, что распределенные вычислительные системы смогут вырваться вперед уже в течение нескольких лет, даже с учетом появления новых суперкомпьютеров.

Основные направления исследований

Без сомнения, распределенные вычисления уже стали распространенным феноменом, следовательно, среди них можно отыскать проекты, занимающиеся решением практически любых научных задач. Тем не менее, самые популярные проекты сконцентрированы на решении довольно узкого круга проблем. В первую очередь это медицина (исследование белков и поиск лекарств), предсказание климата, изучение космоса (поиск внеземных сигналов, правильных моделей вселенной, экзопланет), проверка математических и физических теорий.

Как подключиться к сети распределенных вычислений

Если вы решили, что поиск лекарств от неизлечимых пока болезней или предсказание изменения климата Земли – задачи, достойные того, чтобы выделить под них свой компьютер, то добровольно пожертвовать вычислительную мощность под любой из этих проектов совсем не сложно.

Проще всего это сделать, скачав клиент BOINC и запустив мастер добавления нового проекта. На одном из шагов необходимо будет зарегистрироваться (что можно сделать прямо в программе), вот и все трудности. Если возникли затруднения с выбором конкретного проекта, то можно указать сразу несколько, и они будут считаться по очереди.

По умолчанию BOINC использует компьютер все свободное время, однако выставляет для своих расчетов самый низкий приоритет, так что процессорные ресурсы используются клиентом в самую последнюю очередь.

Что касается памяти, то здесь понятие приоритета неприменимо, а поскольку на многоядерных процессорах BOINC запускает сразу несколько копий расчетов, каждая из которых может занимать в памяти несколько сотен мегабайт (такие объемы нужны не для всех проектов), то в играх и других требовательных приложениях все же лучше ставить расчеты на паузу, что можно сделать непосредственно в клиенте.

Более тонкую настройку можно провести в опциях BOINC, указав программе часы использования компьютера, период бездействия ПК, после которого можно запускать расчеты, а также количество процессорной мощности (в процентах), доступной клиенту.

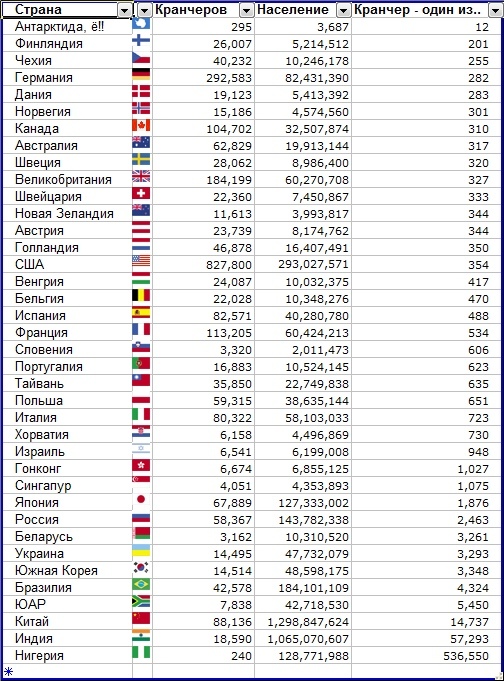

Очки за участие

В большинстве проектов за участие начисляют очки. Их количество напрямую зависит от сложности расчетов, следовательно, чем производительнее компьютер и чем дольше он используется, тем больше очков начисляется. У каждого пользователя есть собственная страница со статистикой, где можно посмотреть личное и командное место в общем зачете (в качестве команды по умолчанию используется страна, указанная во время регистрации).

Популярные проекты Boinc

Boinc — это не распределенная сеть в традиционном понимании, а скорее посредник между проектами и пользователями. Изначально Boinc разрабатывался как клиент для SETI@home, но сейчас с его помощью можно подключиться и к десяткам других проектов.

ClimatePrediction

Самый мощный проект по изучению климата Земли. Занимается моделированием погодных условий будущего (до 2080 года) с учетом различных входных данных. На текущий момент имеет в активе несколько миллионов просчитанных комбинаций. Проект был запущен в 2003 г.

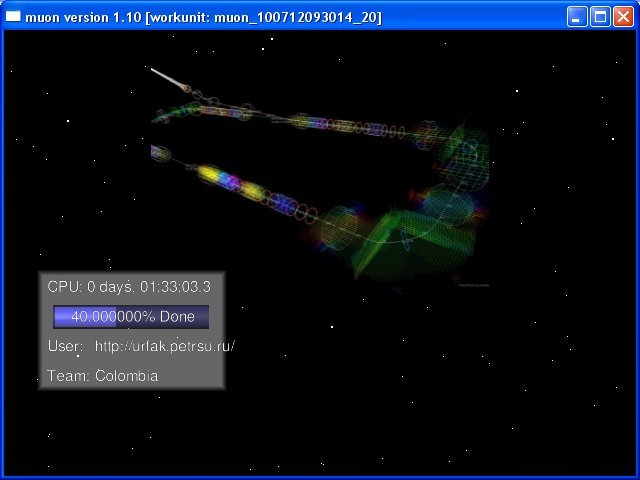

Einstein@home

Проект занимается поиском гравитационных волн, существование которых еще не доказано, но их наличие теоретически было предсказано Эйнштейном почти сто лет назад.

Для обнаружения гравитационных волн обрабатываются данные с радиотелескопов и специальных спутников, наблюдающих за вращающимися нейтронными звездами (пульсарами). За время существования проекта таких объектов было обнаружено более трех десятков.

Результаты проверки, опубликованные в июле 2012 г., свидетельствуют о том, что на текущий момент даже самые чувствительные датчики гравитационных волн не смогли зарегистрировать их наличие, но проект продолжает свою работу, анализируя новые данные и ожидая ввода в эксплуатацию более точных инструментов.

Einstein@home запущен в 2005 г. и на текущий момент его вычислительная мощность составляет приблизительно 0.5 petaFLOPS.

Rosetta@home

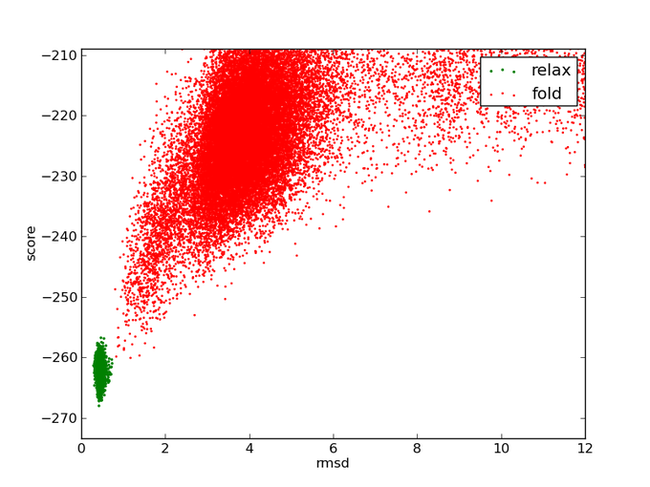

Один из наиболее популярных медицинских проектов, занимающихся виртуальным проектированием и изучением свойств новых протеинов, что может способствовать открытию лекарств от неизлечимых на данный момент болезней.

Проект запущен в 2005 г. и по состоянию на октябрь 2011 г. его вычислительная мощность составляла приблизительно 60 teraFLOPS (0.06 petaFLOPS)

Folding@home

Возможно, самый популярный проект распределенных вычислений. По вычислительной мощности уже сопоставим со всеми проектами, входящими в состав BOINC. Занимается практически тем же, что и Rosetta@home, т.е. изучением свойств белка, и с момента запуска благодаря ему были опубликованы более ста научных работ.

Большой мощности проект смог достичь как за счет раннего старта (2000 год), так и за счет выпуска очень производительного клиента для PlayStation 3 (2007 год), а также оптимизации расчетов под многоядерные процессоры и видеокарты, выполняющие вычисления, как правило, в несколько раз эффективнее самых современных CPU.

SETI@home

Один из ветеранов распределенных вычислений. Запущен в 1999 году, и таким образом, после десятилетий поиска внеземных сигналов в застенках научных лабораторий, к дешифровке космических радиоволн подключились и обычные компьютеры.

Несмотря на тринадцатилетний стаж, проект до сих пор не получил ни одного результата, сравнимого по скандальности с сигналом «Wow!», зарегистрированном в 1975 г. Тем не менее, на небе было найдено несколько точек — кандидатов на более тщательное сканирование, в связи с повышенной интенсивностью сигналов на фоне обычного шума. Вычислительная мощность проекта составляет приблизительно 0.5 petaFLOPS.

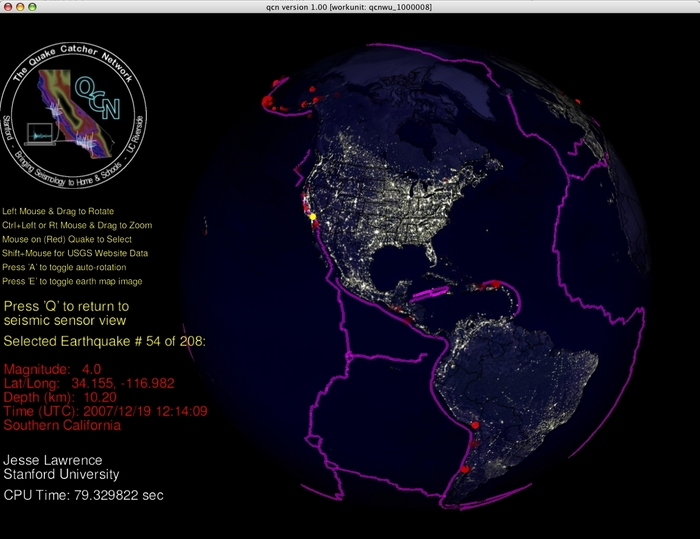

Milkyway@home

Проект воссоздания трехмерной модели нашей Галактики, позволяющий узнать историю формирования Млечного Пути.

Помимо этого, просчитываются процессы столкновения и слияния Галактик.

Cosmology@home

Проект занимается созданием виртуальных моделей Вселенной и последующим сравнением их свойств со свойствами наблюдаемой Вселенной с целью поиска наиболее соответствующей модели. Полученные данные затем могут использоваться для планирования новых астрофизических исследований и экспериментов, а также для лучшей подготовки к анализу данных, поступающих от новейших космических миссий.

Хотите принять участие в распределенных вычислениях, тогда, Вам сюда:

«Мы оказались не готовы к концу действия закона Мура»

Давид Ротман, главный редактор MIT Technology Review, опубликовал в своем издании колонку о том, что закон Мура, действовавший на протяжении последних 50 лет и предопределивший весь современный технологический прогресс, причем не только в технике, но и, например, в медицине, доживает последние годы, а никакой технологии-преемницы у нас нет. Если мы не хотим замедления экономического роста и технологического развития, следует сообща вкладывать в поиск новых решений, считает Ротман.

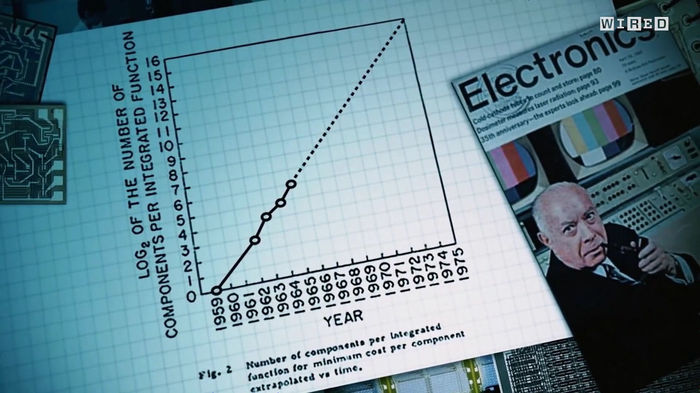

В 1965 году Гордон Мур предсказал, что число компонентов интегральной схемы будет удваиваться каждый год, пока не достигнет в 1975 году невероятного для того времени значения 65 000. Когда в 75-м он оказался прав, то пересмотрел свой закон — теперь число транзисторов удваивается каждые два года. С тех пор его прогноз определял траекторию развития технологии и, в значительной мере, темпы прогресса, пишет главред MIT Technology Review.

Аргументы Мура были экономическими. Он понял, что цена за компонент интегральной схемы почти обратно пропорциональна числу компонентов. Другими словами, чем больше транзисторов добавляешь, тем дешевле они становятся. Вскоре эти дешевые и мощные чипы стали «технологией общего назначения» — чем-то настолько фундаментальным, что оно порождало новые инновации в различных отраслях, от компьютеров и смартфонов до генетики и искусственного интеллекта.

Но что произойдет, когда закон Мура перестанет действовать? Или, как предполагают некоторые, он уже умер, а мы все еще продолжаем двигаться вперед по инерции?

«Все кончено. В этом году это стало совершенно очевидно», — сказал Чарльз Лейсерсон из MIT, пионер параллельных вычислений. Новая фабрика Intel, предназначенная для производства чипов размером 10 нм, была запущена с большим опозданием и начала выпуск следующего поколения только через пять лет после прошлого. Закон Мура, считает Лейсерсон, всегда касался темпов прогресса, а «мы больше не прогрессируем». Он не один, кто считает так же, — с ним соглашается руководство Nvidia.

Спад темпов не был резким — на протяжении десятков лет многие, включая самого Мура, предвидели конец пути, поскольку уменьшать размеры транзисторов становилось все сложнее. Для решения этой проблемы изобретались новые методы литографии, но прогресс требовал все больше затрат. По подсчетам экономистов, исследования по сохранению закона Мура подорожали в 18 раз с 1971.

Отсрочить неизбежное можно, например, программными методами. Аналитики показали, что требовательные вычисления можно ускорить в 47 раз, перейдя везде, где можно, с языка Python на C, который хоть и требует от программиста больше труда, но существенно снижает число операций, так что программы работают быстрее.

Однако рано или поздно — лет через 10 или 30 — разработчикам понадобится более мощное устройство. Проблема в том, что преемник современных чипов неизвестен, и пройдет много лет исследований, прежде чем он будет найден. Так что «момент для паники уже настал», — считает профессор Эрика Фукс из Университета Карнеги-Меллон.

В 2018 Фукс вместе с коллегами опубликовали исследование, посвященное закону Мура. В нем говорилось, что пора прекратить погоню за краткосрочной прибылью и сообща усилить инвестиции в поиск новых компьютерных технологий.

При этом нет никаких гарантий, что эти инвестиции окупятся. Квантовые компьютеры, транзисторы из карбоновых нанотрубок, даже спинтроника — все это многообещающие возможности, но ни одна из них не может заменить простую интегральную схему. Несмотря на это, инвестировать в исследования необходимо, считают авторы. Потому что один прогноз сбудется наверняка: человечеству понадобится больше вычислительной мощности.

Процессоры и маркетинг в компьютерных технологиях.

Проблема закона мура. Закат эры микропроцессоров когда нет альтернатив.

Журнал Electronics в 1965 году опубликовал широко известную сейчас статью об объединении компонентов интегральных систем, автором которой был Гордон Мур, в будущем основавший корпорацию Intel. В свое время это было сенсацией, особенно в те времена когда компьютер казался чем то невероятным даже для образованных людей. Мур провел анализ развития компьютерных технологий за последние 5 лет и вывел прогноз на следующие 10. Гордон Мур буквально задал темпы развития технологий, и уже четыре десятилетия разработчики процессоров следуют ему. Этот закон не является научным, физическим или каким либо законом как таковым, это лишь наблюдения одного человека за развитием одной компании, который вдруг начал работать. Стоит понять, почему?

Следуя этому закону очень просто прогнозировать развитие it технологий и компаний которые эти технологии предоставляют. Стало понятно, что это именно то, что нужно для компаний: потребитель ожидает прирост производительности вдвое каждые 2 года, и производителю нет нужды говорить об этом, потребитель и так ожидает этого. Также, можно сказать, этот закон регулирует темпы развития. Можно сделать прорывную, очень современную технологию, но после долгое время невозможно будет выпустить что то более технологичное. Для производителя очень важно обновление поколений, преимущества нового должны быть очевидны, цена обычно ниже, а производительность выше. За исключением довольно дешевых решений. Тут важно продать большое количество не слишком современных решений и только так это принесет доход, обновлять их практически бессмысленно. Это было очевидно даже в те времена, и компания intel приняла на вооружение этот закон, начала следовать ему, а там и вся индустрия подтянулась. Стоит сказать, что подобные законы не слишком хороши. Их проблема в очень малой гибкости самого представления увеличения мощности при уменьшении размеров. В погоне за мощностью мы постоянно встречаемся со стеной ограничений проблем, которые нам нужно решить здесь и сейчас, или компания не сможет выпустить новое поколение процессоров. Некоторые ограничения были очень мощные, и это большая заслуга тех людей, что делали архитектуры этих процессоров, что удалось обойти эти ограничения. Это подгоняло всю индустрию, несвоевременное представление технологий в их не очень качественном виде могло выдать проблемы в будущем. В другие времена технологии позволяли создать настоящий прорыв, но это решали забыть как страшный сон и все таки следовать закону.

Есть несколько основных ограничений на пути развития процессоров:

-технологические проблемы печати транзисторов очень малых размеров.

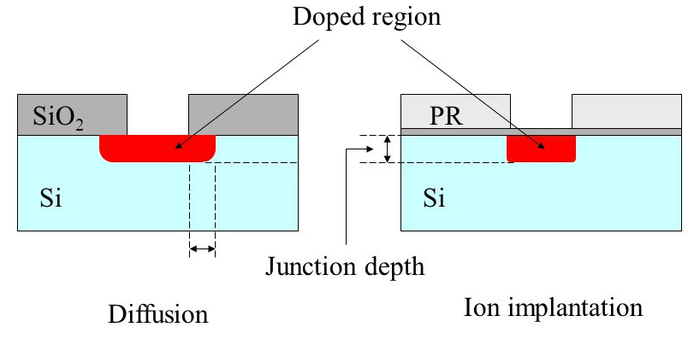

Диффузия против ионной имплантации.

Два принципиально отличающихся друг от друга метода печати полупроводников, от которых зависит, насколько малый техпроцесс мы может напечатать. Если не вдаваться в сложную терминологию, то диффузию описывают так: при термической диффузии максимальная концентрация примеси всегда на поверхности и монотонно убывает с глубиной т.е. с помощью некоторых факторов (температуры, концентрации) мы можем регулировать скорость диффузии, но процесс неизбежно распространяется во все стороны (растекается) увеличивая максимально возможный техпроцесс. Но на его замену пришел более современный метод легирования при ионной имплантации атомы легирующей примеси ионизируют в сильном электрическом поле и облучают потоком ионов поверхность пластины с подготовленной заранее оксидной маской, что дает нам возможность управлять процессом во все стороны. На данный момент этот способ легирования еще имеет потенциал и не требует замены.

-ограничения размерности кристалла.

Длина распространения волны света, очевидно, зависит от ее частоты. Волна частотой 4000Мгц имеет длину 7.5 см. Учитывая то, что волна в процессоре распространяется не прямолинейно, то максимальный размер кристалла кремния процессора еще меньше, именно тот, который мы привыкли видеть, и нельзя сделать его больше.

-проблема высокого потребления процессоров.

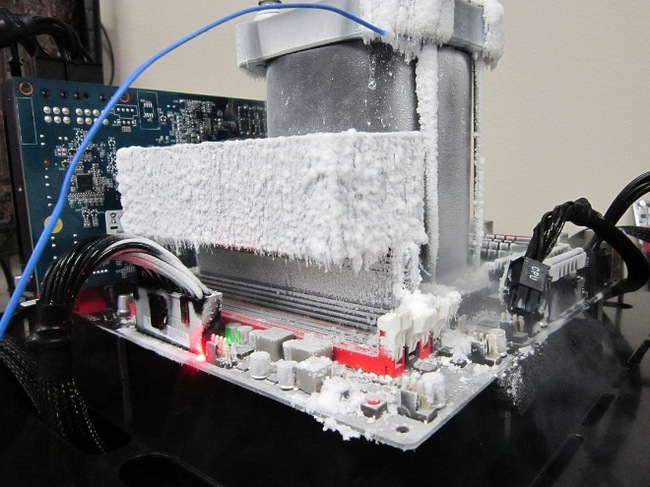

С возрастанием частоты, числа транзисторов и некоторых других факторов прямо пропорционально возрастает нагрев. Он всегда должен быть в разумных пределах, никто не захочет покупать процессор который придется охлаждать с применением жидкого азота. Потребление уменьшается с уменьшением техпроцесса, т.к. свет преодолевает меньшее расстояние и приводит к меньшему нагреву, также процессор нагревается неравномерно, но для его эффективного охлаждения нужно распределить температуру.

Прогрессирующее возрастание потребления от частоты процессора в этом случае накладывает очень жесткие рамки по максимальной частоте процессора, когда то давно это было не очевидно, все представляли процессор будущего с частотой в десятки раз превышающие те, что мы видим сейчас. Условно говоря, повышение частоты процессора в 2 раза дает нам в 2 во второй степени раза большее потребление и тепловыделение. Тем не менее даже без возрастания тактовой частоты теми темпами, что были в прошлом веке закон Мура в некотором смысле работал, и процессоры действительно становились мощнее, другими способами.

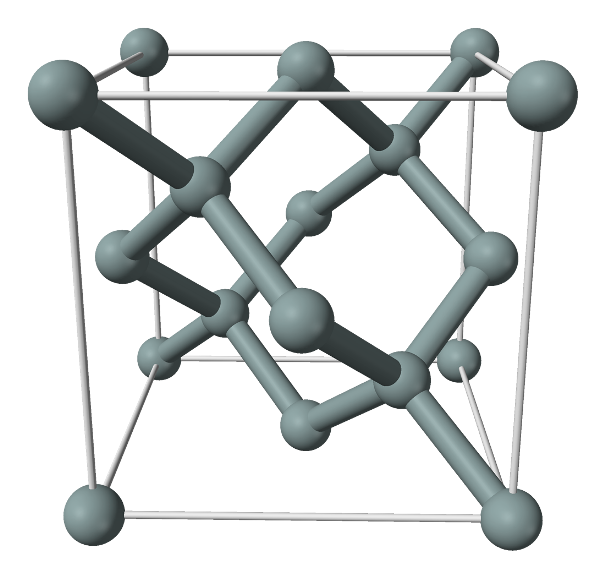

-ограничения размерности кристаллической решетки кремния.

Минимальная размерность полупроводникового затвора транзистора ограничена не только технологиями, при которых достигается минимально возможный размер элемента, но и размером кристаллической решетки кремния. Ее размерность составляет 0.5 нанометров, но определенно элемент не может быть такого же размера, что и кристаллическая решетка и близко к нему. Можно сделать вывод, что минимальный возможный размер затвора может быть равен примерно 1 нанометр, но это теряет смысл, так как настолько близко расположенные затворы не смогут работать вместе с другими, что вызовет сбои. Сложно предугадать, какие технологии будут использованы в будущем, но, скажем, размер затвора в 4 -5 нанометров можно считать предельным, но только лишь для кремния.

Закон Мура и современный рынок процессоров.

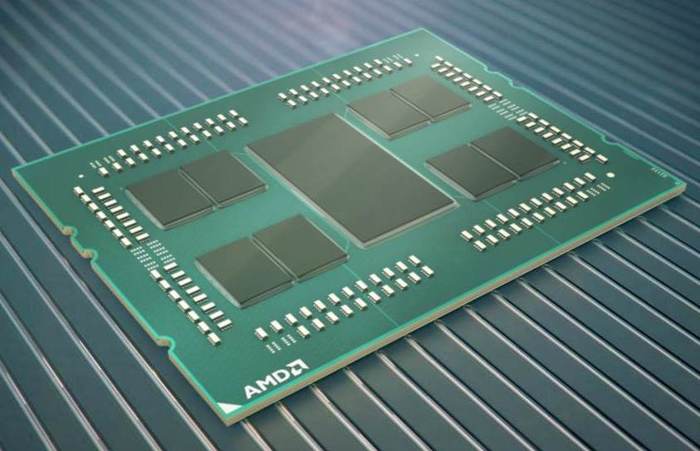

Рынок процессоров уже давно находится в стагнации. Мало того, что разработка новых технологий постепенно замедляется, так еще и эти технологии не приносят очевидного прироста производительности. Тем не менее, мы не замечаем каких либо проблем, новые процессоры все же мощнее и лучше старых. Когда производительность на ядро достигает своего пика, на помощь приходит многоядерность и многопоточность. Стратегия популяризации многоядерных систем довольно перспективная стратегия развития. Ее придерживается компания AMD. Популяризация многоядерности необходима потому, что далеко не все программы и приложения поддерживают большое количество ядер. Некоторым и вовсе необходим один высокопроизводительный поток, который по производительности будет слабее на многоядерном процессоре чем на процессоре с количеством потоков меньше 8 (при схожей частоте и техпроцессе). Но необходимо менять это. Многоядерный процессор намного более многозадачен, когда программа использует довольно мало ресурсов процессора но при этом занимает поток. Многоядерный процессор очевидно лучше справится с этим и будет менее нагружен. Нам же остается только ждать.

Элон Макс Применяет Закон Мура к Марсу...... и ошибается.

Мы снимаем шляпы перед Элоном Маском. Благодаря ему у нас есть PayPal, Solar City и Tesla Motors. Другим его идеям, еще более амбициозным, еще предстоит заслужить наше уважение. Взять хотя бы его последний план — отправить людей на Марc. Хотя подробности его остаются слегка туманными, ключевая идея состоит в том, чтобы продавать билеты на Марс по скромной цене в 200 000 долларов к 2024 году.

Конечно, план Маска подразумевает, что кто-то готов вложить 10 миллиардов долларов или больше, чтобы оплатить все эти сенсации и инфраструктуру, о которых Маск рассказал на Международном конгрессе по астронавтике. Также из этого следует, что 10 миллиардов достаточно, но об этом ниже. Когда SpaceX только начинала, Маск обещал, что его ракеты будут в 10 раз дешевле, в 10 раз надежнее и в 10 раз быстрее существующих ракет — по сути, это 1000-кратное улучшение, которое пока не стало правдой и может не стать никогда. Амбиции Маска полагаются на волшебное мышление старой Кремниевой долины, согласно которому экспоненциальная кривая роста предполагает, что космос будет все дешевле и дешевле. Но он не предлагает достаточных технологических улучшений или доказательств спроса, чтобы организовать полеты за 200 000 долларов. Маск исходит из закона Мура для мира компьютеров и автомобилей. Но Марс не подчиняется закону Мура.

Касательно технологий, существуют проблемы двух типов: инженерные проблемы, которые можно решить, и физические проблемы, которые решить не получится, придется только смириться. Решение инженерных проблем обычно включает ключевой параметр производительности, который воплощает в себе суть решения. Это закон Мура. В 1965 году сооснователь Intel Гордон Мур отметил, что общая вычислительная мощь компьютеров — число транзисторов на процессорном чипе одной стоимости — увеличивается каждые два года или почти так. Так родился закон Мура с удивительной S-образной кривой постоянного экспоненциального роста, который гарантирует технологическое разнообразие в будущем.

Кривая роста типа муровской требует стремящееся к бесконечности количество промежуточных этапов совершенствования. С каждым годом процессоры, самолеты или автомобили становятся чуточку лучше, чем были в прошлом году. Экономика масштабируется, затраты снижаются, рынок растет.

В отличие от компьютеров и автомобилей, с которыми Маск, безусловно, знаком, ракеты не могут улучшаться систематически. Удельный импульс — показатель килограммов тяги, производимых на килограмм ракетного пропеллента, топлива — это ключевой параметр, способный приводить к значительному сокращению расходов на доступ к космосу. Технологические решения для улучшения удельного импульса включают строительство ракет полегче или поиск топлива получше. Ракетостроители, в принципе, давно рассчитали свои возможности в оптимизации и того и другого. Остается физическая проблема: масса против гравитации. Единственный способ решить ее — масштабировать экономику, снизив эксплуатационные расходы за счет увеличения темпа запусков.

Но проблема масштабирования экономики в том, что она зависит от спроса. Текущий темп запусков SpaceX многим обязан коммерческим запускам спутников. Информация — это крупнейший рынок космических услуг. Можно было бы надеяться, что рост в области спутниковой связи привел бы к увеличению спроса и тем самым снизил цены, но… Но эту возможность, как это ни странно, отнял закон Мура — который позволил спутникам передавать больше информации. Спутники связи не особо увеличили спрос на запуск массы на орбиту.

Чтобы привести космические пилотируемые полеты в соответствие с нашим спросом и снизить при этом их стоимость, нам нужно перейти от братьев Райт к «Конкордам» без промежуточных этапов. Существует несколько «островков стабильности» — отдельных высот для пилотируемых миссий — рубеж в 100 километров для туристов, низкая околоземная орбита, Луна, Марс. Точно так же был X-Prize для полета на высоте 100 километров, но не для 200. Однако разница между ними колоссальная с позиции затрат. Никто не помнит первого астронавта, который пролетел полпути к Луне, потому что всем безразлично, что там. Нет ничего между маленьким шагом для человека Нила Армстронга и его гигантским скачком для человечества. Сама природа космоса делает постепенные шаги сомнительными.

Одна из фундаментальных проблем больших дальновидных проектов вроде отправки людей на Марс в том, что они не делают ничего, чтобы решить основные проблемы физики, законы термодинамики и, что самое важное, как это все оплатить. Маск игнорирует тот факт, что NASA и другие агентства набрасывают подобные планы захвата Марса уже больше пятидесяти лет. Он отметает риски и технические ограничения существующих технологий, делая этот план надежным, дешевым и безопасным, как если бы он следовал закону Мура. Он уклоняется от обсуждения инфраструктуры и работы, необходимой, чтобы все это поднять. Оставляя, таким образом, пространство для спекуляций.

Закон Мура — это продукт Кремниевой долины, как и склонность к растрате средств и преувеличению. В 2013 году журнал Time выложил на первой полосе историю с заголовком «Может ли Google решить вопрос смерти?». Но люди продолжают умирать. Марк Цукерберг и его супруга Присцилла Чан анонсировали мероприятие на 3 миллиарда долларов, чтобы «положить конец большинству заболеваний к концу века». Притом что годовой бюджет Национальных институтов здравоохранения составляет больше 30 миллиардов долларов и не дает никаких обещаний. Маск оценивает, что поездка на Марс обойдется ему в 10 миллиардов долларов. Всякий раз, когда NASA рассматривает возможность пилотируемой миссии на другую планету, его цифры переваливают за 150 миллиардов (плюс-минус), которые были потрачены на программу «Аполлон». Не всякая проблема решается хорошими инженерами.

Видение без финансирования — это галлюцинация. Проблема Марса — не как, а зачем. Боюсь, придется немного поостыть. В конце концов, полетами на Марс грезил и Вернер фон Браун пятьдесят лет назад, и что, и где?

Как подготовить машину к долгой поездке

Взять с собой побольше вкусняшек, запасное колесо и знак аварийной остановки. А что сделать еще — посмотрите в нашем чек-листе. Бонусом — маршруты для отдыха, которые можно проехать даже в плохую погоду.